服务器的发展历史

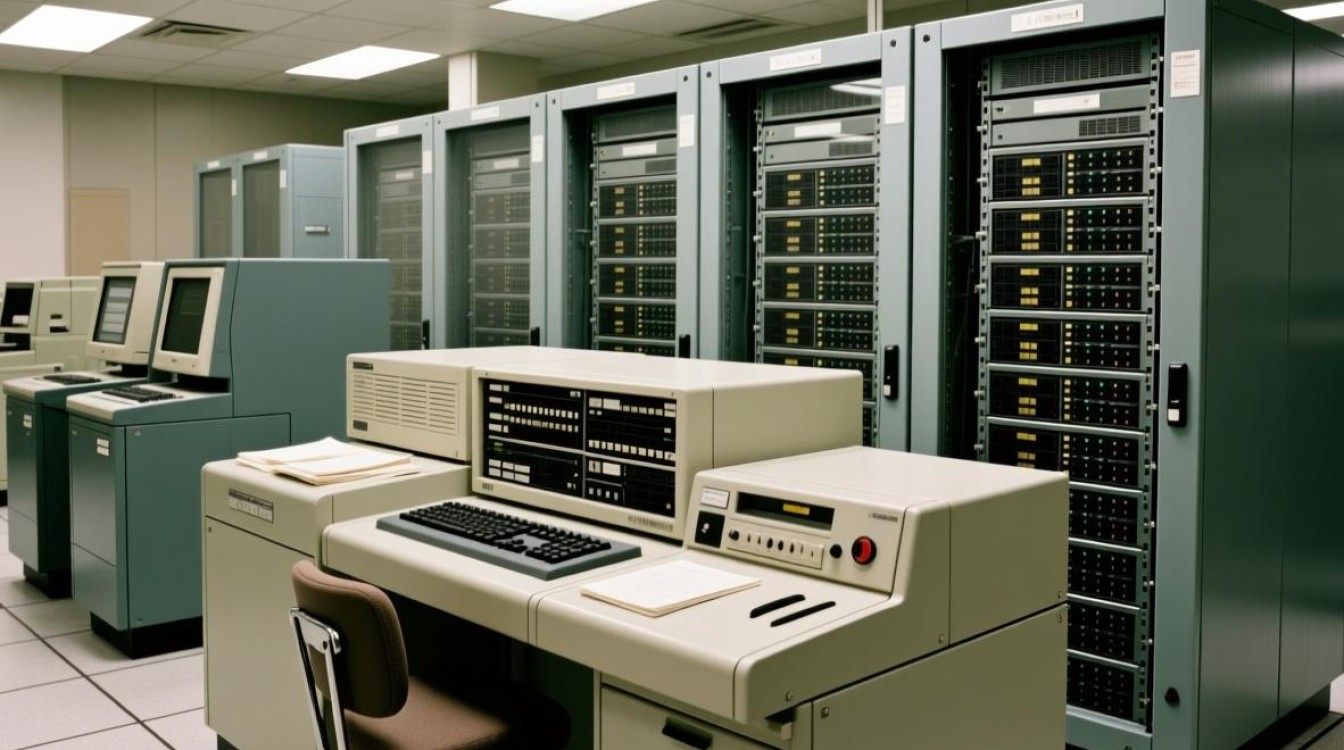

早期雏形:大型机与批处理时代(1940s1960s)

服务器的概念可追溯至20世纪40年代,当时以ENIAC为代表的电子计算机主要用于科学计算,尚未形成“服务器”这一明确分类,随着1950年代大型机的出现,如IBM的System/360,计算机开始承担集中式数据处理任务,这一时期的服务器以批处理模式运行,多个用户通过终端共享计算资源,操作系统如OS/360初具多任务处理能力,但硬件体积庞大、成本高昂,仅限大型机构使用。

分时系统与小型机崛起(1960s1970s)

1960年代末,分时系统的革新推动了服务器技术的进步,DEC公司的PDP系列小型机首次以较低成本提供多用户交互支持,使服务器逐渐从实验室走向企业,操作系统如Unix(1969年诞生)强调“一切皆文件”的设计哲学,为后续服务器软件架构奠定基础,这一阶段,服务器开始以独立形态存在,但仍以单机运行为主,网络功能尚未普及。

局域网与文件服务器的普及(1980s)

个人计算机的浪潮催生了对网络共享的需求,1980年代,Novell的NetWare操作系统和3Com以太网卡推动了局域网的普及,专用文件服务器应运而生,这类服务器负责集中存储数据、管理打印队列,并基于IPX/SPX协议实现资源共享,硬件方面,基于x86架构的PC服务器逐渐崭露头角,如IBM的PC Server系列,以性价比优势挑战传统小型机市场。

客户机/服务器模式与互联网黎明(1990s)

1990年代,万维网(WWW)的爆发式增长彻底重塑了服务器形态,基于TCP/IP协议的互联网应用兴起,HTTP服务器(如NCSA Apache)成为主流,客户机/服务器(C/S)模式取代了传统的主机终端架构,数据库服务器(如Oracle、SQL Server)和应用服务器(如IBM WebSphere)分工明确,硬件层面,RISC架构(如Sun SPARC、HP PARISC)服务器凭借高性能支撑关键业务,而Linux操作系统的开源特性降低了服务器部署门槛。

虚拟化与云计算革命(2000s2010s)

2000年后,虚拟化技术(如VMware、KVM)的成熟打破了“一台服务器一个应用”的限制,大幅提升资源利用率,云计算概念的兴起推动了服务器形态的变革:从物理机到虚拟机,再到容器化(Docker、Kubernetes),大型科技公司(如亚马逊AWS、谷歌GCP)构建的数据中心采用分布式服务器集群,通过弹性计算和按需服务模式,重新定义了IT基础设施,硬件方面,多核CPU(如Intel Xeon、AMD EPYC)、高速SSD和InfiniBand网络成为标配,支持超大规模并发处理。

智能化与边缘计算时代(2020s至今)

随着5G、物联网和AI技术的融合,服务器正向“云边端”协同架构演进,云端服务器聚焦AI训练和大数据分析,搭载GPU/TPU等加速芯片;边缘服务器则部署在靠近数据源的边缘节点,满足低延迟需求,液冷技术、高密度设计(如刀片服务器)和绿色节能理念成为行业焦点,以应对数据中心能耗挑战,服务器操作系统(如Windows Server、CentOS)持续优化安全性,支持混合云管理和自动化运维。

相关问答FAQs

Q1: 虚拟化技术如何改变了服务器的使用方式?

A1: 虚拟化技术通过将物理服务器资源(CPU、内存、存储)抽象成多个虚拟机,实现了“一机多用”,它打破了传统服务器单任务运行的限制,提升了资源利用率,降低了硬件成本和运维复杂度,虚拟机快照、热迁移等功能增强了系统的灵活性和灾备能力,为云计算和动态资源调度奠定了基础。

Q2: 边缘计算服务器与传统云服务器的主要区别是什么?

A2: 边缘计算服务器更靠近数据源(如工厂、基站),强调低延迟、高带宽和本地化处理能力,适用于实时IoT数据分析和自动驾驶等场景;而传统云服务器集中部署在大型数据中心,擅长大规模计算和存储,但对网络延迟敏感,边缘服务器通常采用紧凑设计、节能方案,并支持离线运行,以适应边缘环境的复杂条件。